Китайские ученые из компании Tencent Keen Security Lab выявили несовершенства программного обеспечения адаптивного круиз-контроля Tesla Autopilot и смогли обмануть систему распознавания разметки.

Ученые описали эксперимент в статье. В ней говорится, что система адаптивного круиз-контроля Tesla Autopilot не может правильно распознавать точки на асфальте, считать их элементами дорожной разметки и сворачивать.

В ходе эксперимента сотрудники Tencent Keen Security Lab прикрепили небольшую наклейку на дорогу и смогли отправить автопилот на встречную полосу.

Ученые также активизировали стеклоочиститель автомобиля, показав камере специальные изображения. К тому же программисты смогли получить удаленный доступ к бортовому компьютеру, чтобы управлять углом поворота руля с помощью геймпада.

В Tesla прокомментировали эксперименты китайских ученых. "В этой демонстрации исследователи изменили физическую среду вокруг транспортного средства, чтобы заставить его вести себя иначе. Это не реальная проблема, не та, с которой сталкиваются каждый день, учитывая и то, что водитель может в любое время перенять управление автомобилем и нажать на тормоз", - говорится в заявлении компании, которое приводит Business Insider.

Tesla Model 3 ранее обещала выплатить вознаграждение тому, кто найдет уязвимость в программном обеспечении электрокара и взломает систему. Однако сотрудникам Tencent Keen Security Lab, которые "изменили физическую среду", награда не причитается.

11:30

Понедельник

0

6

Очередной автомобильный прорыв: «Aurus» умер, да здравствует «Senat»! - «Авто»

Под видом российского крутого лимузина в Шушарах хотят скручивать китайский «псевдо S-класс»

11:30

Понедельник

0

6

Очередной автомобильный прорыв: «Aurus» умер, да здравствует «Senat»! - «Авто»

Под видом российского крутого лимузина в Шушарах хотят скручивать китайский «псевдо S-класс»

11:30

Суббота

9

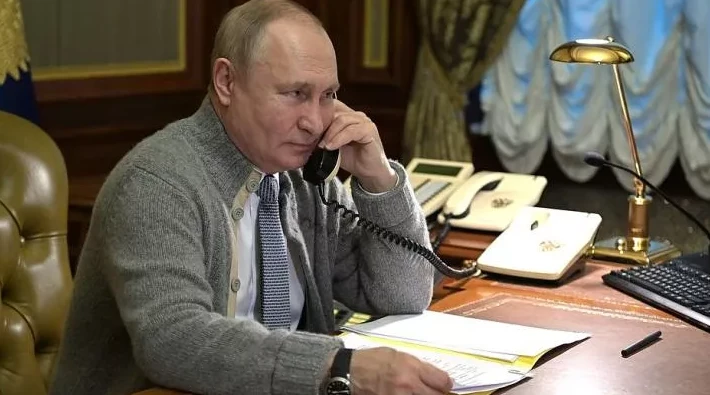

Путин провел переговоры с лидерами Белоруссии и Армении по ситуации в Казахстане - «Спецоперация»

Российский президент обсудил со своим коллегой Александром Лукашенко и премьер-министром Армении

11:30

Суббота

9

Путин провел переговоры с лидерами Белоруссии и Армении по ситуации в Казахстане - «Спецоперация»

Российский президент обсудил со своим коллегой Александром Лукашенко и премьер-министром Армении

11:30

Суббота

7

Подпольная хакерская группа взломала сайты украинских государственных ресурсов - «Спецоперация»

Хакерская группа "Армия спасения Украины" взломала сайты ряда государственных ресурсов,

11:30

Суббота

7

Подпольная хакерская группа взломала сайты украинских государственных ресурсов - «Спецоперация»

Хакерская группа "Армия спасения Украины" взломала сайты ряда государственных ресурсов,

11:30

Воскресенье

7

Русские из Прибалтики, которых не показывают по ТВ: «Хочу вернуться в Литву, в России мы никому не нужны» - «Общество»

11:30

Воскресенье

7

Русские из Прибалтики, которых не показывают по ТВ: «Хочу вернуться в Литву, в России мы никому не нужны» - «Общество»

Происшествия и криминал

11:30

Четверг

0

7

Поездом — загорать в Евпаторию? Так это через Джанкой, а там бомбят! - «Происшествия»

Американские «Шершни» терроризируют водителей по пути в Крым «посуху»

Происшествия и криминал

11:30

Четверг

0

7

Поездом — загорать в Евпаторию? Так это через Джанкой, а там бомбят! - «Происшествия»

Американские «Шершни» терроризируют водителей по пути в Крым «посуху»